EU도 자발적 AI 협약 기업 참여 고민…애플·메타 참여 안해

"AI 윤리 기준 기업 참여 이끌려면 법적 근거 마련해야"

국내뿐 아니라 유럽연합(EU)도 기업이 인공지능(AI) 윤리 기준을 자발적으로 준수하도록 대책 마련에 골몰하고 있다.

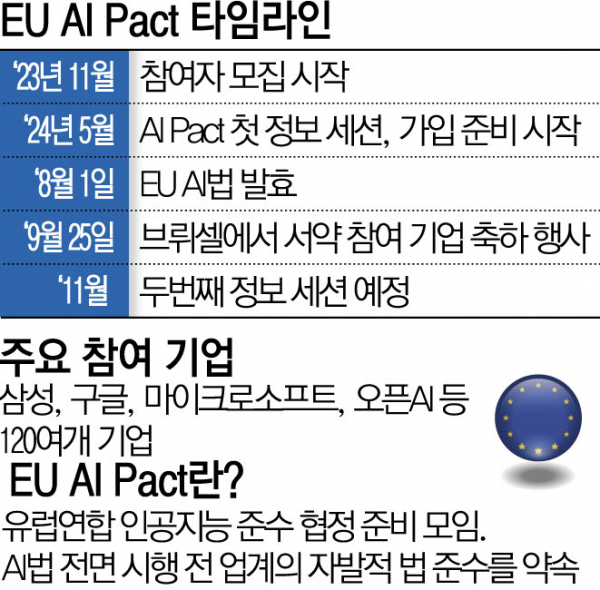

지난달 25일(현지시간) EU는 AI법 시행 전 업계의 자발적 준수를 위한 준비 모임 'AI 협약'(AI Pact)을 발표했다. 삼성, 구글, 마이크로소프트(MS), 오픈AI 등 115개 기업이 이름을 올렸고 이후 조금씩 참여 기업이 늘어 1일 기준 126개 기업이 참여했다.

해당 협약은 2026년 8월 법 전면 시행 전 안전하고 투명한 AI 사용을 위해 노력하겠다는 취지의 자발적 서약이다. 서약 기업들은 '고위험' AI 기술로 분류될 만한 자사 시스템을 사전 점검할 예정이다. AI 법 준수를 위한 조직 내 AI 거버넌스 전략 수립 등도 요구된다. 전체 기업 중 절반 이상은 AI 기술 사용 시 인적 감독 보장, 딥페이크 등 특정 유형의 AI 기반 콘텐츠 표기 등 추가적인 노력도 약속했다.

집행위원회는 지난해 11월부터 협약에 기업들의 참여를 독려해왔다. 올해 5월 첫 모임을 시작으로 지난달 25일 협약 가입 기업을 처음 공개했다. 주요 IT 대기업과 스타트업 등이 협약에 참여했지만, 애플과 메타 등 몇몇 주요 AI 기업은 빠졌다. 애플 관계자는 블룸버그 통신에 "현재로써는 AI법 시행 전 규정을 준수하기 위한 작업에 집중하고 있다"고 밝혔다.

EU 사례에서도 보듯이 결국 윤리 부문에 기업의 자발적 참여를 유도하는 데에는 한계가 있다. 전문가들은 민간의 AI 신뢰성 인증제 참여를 이끌기 위해서는 인증제에 법적 근거를 부여해야 한다고 주장한다. 결국 AI 기본법 등 관련 입법이 필요하다는 것이다.

김명주 서울여대 정보보호학과 교수(바른AI연구센터장)는 “해당 인증이 법적인 요구사항이 아니지 않느냐. 법적 요구사항이 아닌데 기업들이 따로 비용을 들여서 하는 건 부수적인 작업”이라고 말했다. 김 교수는 “유럽연합에서도 AI 기본법 인증에 대한 조항이 있다”며 “만약 유럽연합의 AI 기본법 형태로 (우리나라도) 가게 된다면, 우리는 유럽연합 식의 AI 인증을 다시 준비해야 한다”고 분석했다.

기업과 정부가 서로 요구하는 AI 윤리 기준의 차이를 좁히는 것도 숙제다. 이재성 중앙대 AI학과 교수는 “기업과 정부, 다른 단체에서 요구하는 AI 규제 수준이 서로 다르다”며 “작년에도 AI 기본법을 제정하려고 했지만 산업(기업) 쪽과 민간 단체 측에서 주장하는 AI의 위험 수준과 규제 정도가 서로 상이해 무산되지 않았느냐”고 말했다.

이 교수는 “특히 우리나라에선 규제든 진흥이든 관련 법이 명확하게 안 나와 있는 상황에서 기업은 AI에 섣불리 투자하거나 투자한 AI를 인증받기가 애매하다”며 “우리나라 기업은 액션이고 뭐고 복지부동인 상황. 기업으로선 굳이 손 안 대는 게 낫다고 판단한 거 같다”고 덧붙였다.

!["여기도 품절이라고요?"…Z세대 '뷰티 방앗간' 된 다이소, 다음 대란템은? [솔드아웃]](https://img.etoday.co.kr/crop/140/88/2105870.jpg)

![‘슈팅스타’ 오늘 첫 방송…‘큰 산’ 최강야구 넘을까? [해시태그]](https://img.etoday.co.kr/crop/140/88/2105878.jpg)

![[단독] 부모-자녀 한 동네 사는 실버타운 만든다더니…오세훈표 '골드빌리지' 무산](https://img.etoday.co.kr/crop/140/88/2105453.jpg)

![‘더 게임 어워드’ 올해의 게임 후보 6선…각 작품 경쟁력은? [딥인더게임]](https://img.etoday.co.kr/crop/140/88/2105786.jpg)

![[ENG/SUB]지드래곤(G-DRAGON)의 음악, 다른 아이돌과 뭐가 다른데? [컬처콕 플러스]](https://i.ytimg.com/vi/9hsaYzMk9gc/mqdefault.jpg)

!["여기도 품절이라고요?"…Z세대 '뷰티 방앗간' 된 다이소, 다음 대란템은? [솔드아웃]](https://img.etoday.co.kr/crop/300/170/2105870.jpg)

![절기상 소설, 눈 대신 낙엽 [포토]](https://img.etoday.co.kr/crop/300/190/2105757.jpg)